La Dirección General para las Redes de Comunicaciones, Contenidos y Tecnología de la Comisión Europea acaba de publicar su informe anual para evaluar la eficacia del código de buenas prácticas sobre la desinformación: “Assessment of the implementation of the Code of Practice on Disinformation (SMART 2019/0041 )”.

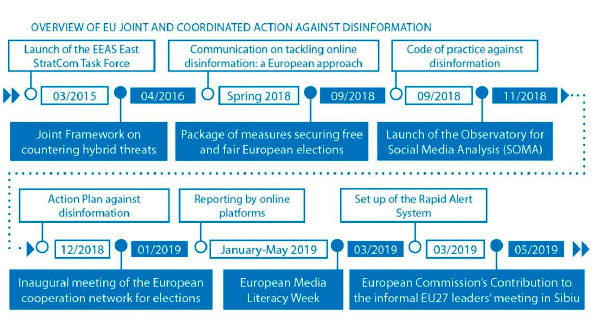

Este informe forma parte del esfuerzo de la Comisión por combatir la desinformación que se describe en la Figura 1. El Consejo Europeo de marzo de 2015 puso en marcha un grupo de trabajo para hacer frente a la campaña rusa de desinformación tras el conflicto con Ucrania (EEAS Stratcom Task Force), seguido de un plan de acción para la comunicación estratégica. La iniciativa pretendía mejorar la capacidad de detección y de respuesta de la UE y, entre otras medidas, comenzó a colaborar con las grandes plataformas en línea.

Hasta entonces, los proveedores de servicios en línea estaban exentos de responsabilidad por los contenidos transmitidos en la UE1, pero la preocupación por la desinformación condujo a un cambio de postura. En marzo de 2018, el Consejo Europeo declaró que “las redes sociales y las plataformas digitales deben garantizar unas prácticas transparentes y la plena protección de la privacidad y los datos personales de los ciudadanos”2. La colaboración llevó en abril de 2018 a una nueva comunicación sobre la desinformación en línea en la que la Comisión planteaba la necesidad de que las plataformas asumieran un papel más activo para proteger a sus usuarios y reconocía la importancia de las plataformas en línea en la difusión. Entre otras recomendaciones, figuraba la de desarrollar una autorregulación eficaz y supervisable, para lo que la Comisión se comprometió a elaborar un código de buenas prácticas que ayudara a identificar, evaluar, contrarrestar y suprimir los contenidos diseñados para la desinformación en línea3.

Tras diversas consultas con las plataformas, anunciantes y asociaciones civiles que iban a suscribirlo, la Comisión adoptó en octubre de 2018 el Código de Buenas Prácticas sobre Desinformación. El compromiso representa el primer ensayo conocido de autorregulación de plataformas como Facebook, Google, Mozilla, Twitter y Microsoft4 y, en cumplimiento de sus compromisos, comenzaron a remitir sus autoevaluaciones a partir de enero de 2019.

La evaluación independiente

Según las conclusiones del informe, que se sintetizan en la Figura 2, la valoración resulta positiva en su conjunto, teniendo en cuanta que es el primer año de la primera experiencia conocida. El proceso en sí mismo, la interacción entre las plataformas y el resto de los actores implicados, constituye un activo importante y, además, representa un precedente para procesos similares en otras regiones o países.Figura 2. Principales conclusiones del informe

| Objetos | Conclusiones |

|---|---|

| Escrutinio de los anuncios | Se han tomado medidas para valorarlos, pero todavía no se puede constatar su eficacia directa. |

| Información política y temas polémicos | Se han registrado más avances en el primer aspecto que en el segundo, donde las culturas nacionales dificultan la comprensión. |

| Integridad de los servicios | Se han puesto en marcha instrumentos para detectar comportamientos simulados coordinados por actores maliciosos, pero se desconoce cómo interactúan. |

| Usuarios | Se han creado herramientas y ha aumentado la concienciación social, pero todavía no se puede medir la correlación causal entre medios y efectos. |

| Analistas | Se puede investigar, pero persisten los problemas de acceso y uso de los datos, así como la desconfianza mutua entre los investigadores y los propietarios de las bases de datos. |

Fuente: “Assessment of the implementation of the Code of Practice on Disinformation, SMART 2019/0041”, pp. 4-5.

La evaluación propone corregir algunas de las deficiencias encontradas, como el desigual cumplimiento y progreso según las plataformas, objetivos y países. Algunos obedecen a problemas conceptuales vinculados a los objetivos que supervisar; por ejemplo, la distinta percepción de lo que puede resultar polémico para una sociedad. Por ello, se recomienda reflexionar sobre las dificultades encontradas, mantener el proceso en marcha y, si es necesario, que la Comisión empiece a regular los asuntos que bloquean el avance de la cooperación. En este sentido, la Comisión acaba de iniciar la revisión del marco regulatorio del paquete Digital Services Act mediante una consulta pública sobre aspectos relacionados con la desinformación, la responsabilidad de las plataformas y la libertad de expresión.

Desinformación, plataformas y COVID-19

La desinformación ha sido uno de los aspectos más destacados en relación con la crisis pandémica. Por las redes sociales han circulado algunas campañas que ponían en duda la utilidad de las vacunas, los fármacos o los servicios sanitarios, una desinformación recurrente que se ha incrementado durante la pandemia. Más novedosa –y peligrosa– ha sido la desinformación que ha circulado que atribuía la difusión del coronavirus a las redes 5G, lo que ha generado más de un centenar de ataques sobre torres y técnicos en países de la UE que se suponen inmunes a este tipo de desinformación5.

El último informe disponible del Servicio Europeo de Acción Exterior (SEAE) analiza con profusión las campañas de desinformación de origen estatal que aprovechan la pandemia, pero también incluye alguna consideración sobre las plataformas6. Valora su esfuerzo para detectar y contrarrestar la información errónea y la desinformación, pero les pide mayor esfuerzo. Entre otras, plataformas como Twitter han facilitado el acceso de los investigadores a decenas de millones de tuits públicos diarios sobre la pandemia, uno de los instrumentos incluidos en el código de buenas prácticas que se ha podido desarrollar sobre la pandemia. Otro instrumento del código que se ha mostrado de utilidad ha sido el seguimiento de conductas simuladas (inauthentic) de actores maliciosos, que ha llevado a Facebook a cerrar ocho redes de desinformación (seis de ellas ubicadas en los Estados Unidos, Georgia, Birmania y Mauritania, además de las dos atribuidas a Rusia e Irán).

Según el mismo informe del SEAE, YouTube y Facebook han eliminado las imágenes de un falso documental titulado Plandemic debido a su potencial daño para la salud, pero el vídeo ha seguido circulando, lo que reafirma la necesidad de que las plataformas continúen desarrollando el mencionado código. Finalmente, el informe recoge investigaciones independientes sobre las redes sociales que demuestran el incremento exponencial de la información por verificar, lo que presenta una complicación adicional para la detección de contenidos junto con la creciente sofisticación de los desinformadores para superar los filtros que utilizan las plataformas. Precisamente, otro problema que se detecta en la verificación de datos (fact checking) es que no todas las plataformas responden o reaccionan al mismo ritmo en todos los idiomas. Así, según la organización Avaaz, los usuarios en español (70%) e italiano (68%) de Facebook reciben más contenidos sin alerta de desinformación frente al 29% de los contenidos en inglés7.

Finalmente, aunque fuera del ámbito europeo, es de reseñar el positivo respaldo que ha supuesto la experiencia europea de autorregulación para plataformas como Twitter. La compañía empezó a usar a principios de mayo una nueva herramienta de comprobación de datos que acabó añadiendo advertencias de comprobación a tuits del mismísimo presidente de los Estados Unidos, Donal Trump. Sus homólogos europeos pueden correr la misma suerte si emulan su conducta, pero no podrán acusar a la plataforma tecnológica de coartar la libertad de expresión, como ha ocurrido en Estados Unidos, porque fueron ellos los que urgieron a las plataformas a desarrollar esas herramientas.

1 Artículo 12 y considerando 43 de la Directiva 2000/31/CE, de 8 de junio de 2000, sobre el comercio electrónico.

2 Conclusiones adoptadas por el Consejo Europeo sobre la Europa Digital, EUCO 1/18, de 23 de marzo.

3 A la comunicación se llegó tras un proceso de consultas públicas, negociación con las partes, un sondeo de opinión del Eurobarómetro y un informe del Grupo de Alto Nivel.

4 Véanse Facebook Roadmap for implementation of Code of Practice, Google signed Code of Practice, Google Roadmap for implementation of Code of Practice, Mozilla signed Code of Practice, Mozilla Roadmap for implementation of Code of Practice, Twitter signed Code of Practice, Twitter Roadmap for implementation of Code of Practice y Microsoft signed and Roadmap for implementation of Code of Practice. Un listado completo de los miembros y sus hojas de ruta se encuentra en Roadmaps to implement the Code of Practice on disinformation, https://ec.europa.eu/digital-single-market/en/news/roadmaps-implement-code-practice-disinformation.

5 ETNO, UNI Europa ICTS y GSMA han condenado más de 120 ataques contra empleados y redes 5G a los que se les atribuye la expansión del COVID (UK, NL, FR, DE, IR, BE, IT, SE, FI, CY).

6 Informe especial del SEAE, 20 de mayo de 2020, EUvsDisinfo.

7 Avaaz, “How Facebook can flatten the curve of the coronavirus infodemic”, 15/IV/2020.